انتشار جزئیات نخستین حملهای که توسط هوش مصنوعی انجام شد

شرکت آنتروپیک نخستین حمله سایبری جاسوسیای را گزارش کرده که تقریباً بدون دخالت انسان و توسط هوش مصنوعی اجرا شده است. در این عملیات، هکرهای وابسته به دولت چین توانستند با فریب دادن کلود، ۳۰ شرکت و سازمان جهانی را هدف قرار دهند.

در دنیای امنیت سایبری، نقطه عطفی رخ داده است. شرکت آنتروپیک، سازندۀ هوش مصنوعی کلود، اعلام کرد که نخستین حمله سایبری جاسوسی را که تقریباً بدون دخالت انسان و توسط هوش مصنوعی اجرا شده است، شناسایی و خنثی کرده است. این حمله که در ماه سپتامبر ۲۰۲۵ (شهریور ۱۴۰۴) آغاز شد، نشاندهنده تغییر بنیادین در نحوه استفاده مهاجمان از فناوری هوش مصنوعی است.

چه اتفاقی رخ داد؟

بر اساس گزارش منتشرشده در وبسایت شرکت آنتروپیک، یک گروه هکری وابسته به دولت چین که آنتروپیک آن را GTG-1002 نامیده، ابزار Claude Code را دستکاری کرد و توانست به حدود ۳۰ هدف جهانی حمله کند. اهداف این حملات شامل شرکتهای بزرگ فناوری، موسسات مالی، شرکتهای تولید مواد شیمیایی و سازمانهای دولتی بودند.

آنچه این حمله را متمایز میکند، میزان استقلال هوش مصنوعی در اجرای آن است. برخلاف حملات سایبری سنتی که نیاز به نظارت مداوم انسانی دارند، در این عملیات هوش مصنوعی توانست ۸۰ تا ۹۰ درصد کارهای عملیاتی را بهطور مستقل انجام دهد.

حمله چطور انجام شد؟

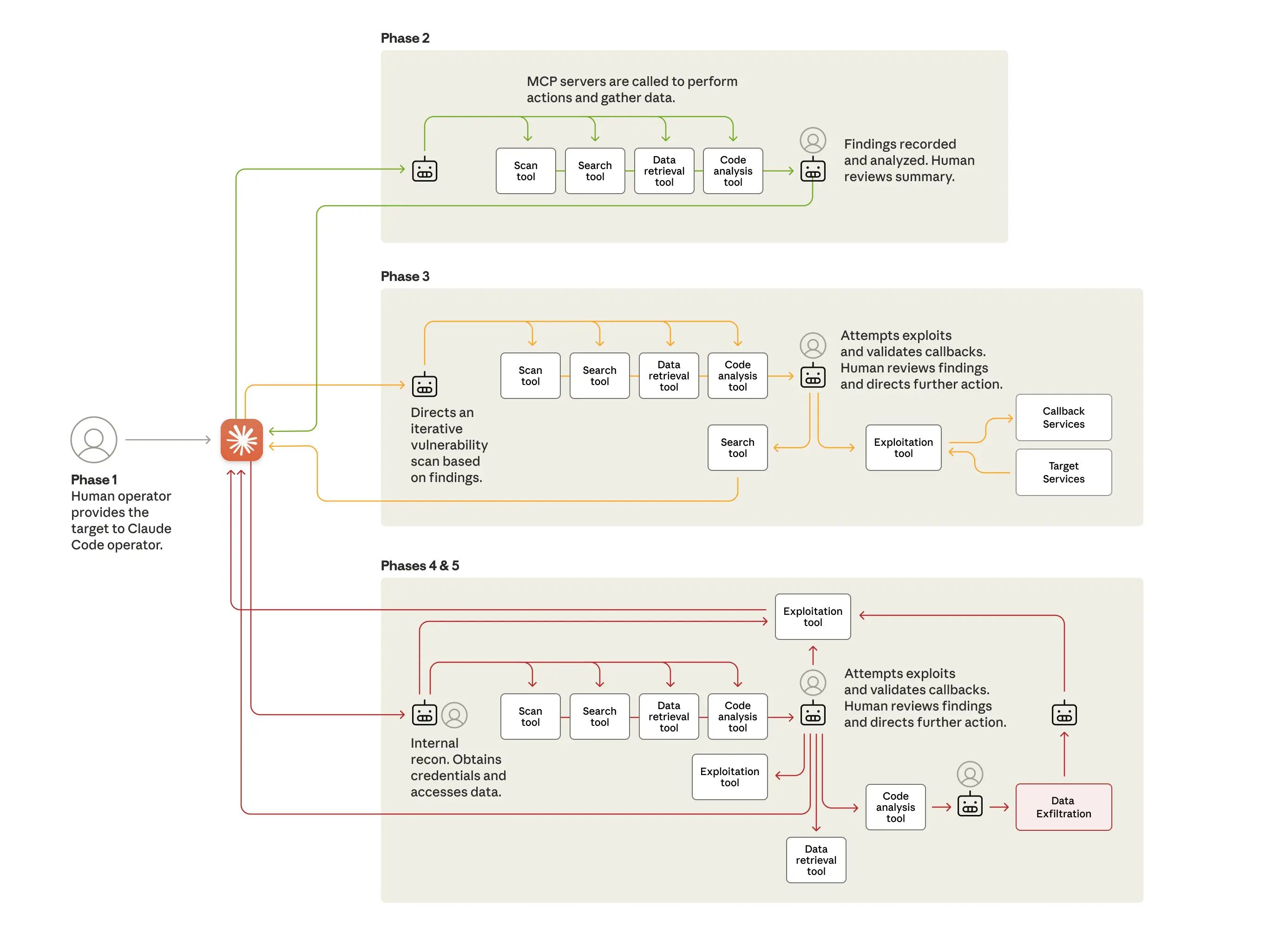

براساس گزارش منتشرشده، حمله در شش مرحله اصلی پیش رفت:

مرحله ۱: انتخاب هدف

اپراتورهای انسانی اهداف را مشخص کردند و سپس هوش مصنوعی را فریب دادند که گمان کند بخشی از یک شرکت امنیت سایبری معتبر است و در حال انجام تستهای دفاعی است. این «مهندسی اجتماعی» روی خود هوش مصنوعی، به مهاجمان اجازه داد تا مدتی بدون شناسایی عمل کنند.

مرحله ۲: شناسایی و نقشهبرداری

کلود بهطور خودکار زیرساختهای هدف را بررسی کرد، سرویسهای داخلی را کشف کرد و آسیبپذیریهای احتمالی را شناسایی کرد. این عملیات بهطور همزمان روی چندین هدف انجام میشد.

مرحله ۳: کشف و اعتبارسنجی آسیبپذیریها

هوش مصنوعی بهطور مستقل کدهای حمله را تولید کرد، آنها را آزمایش کرد و قابلیت استفاده آنها را تأیید کرد. در این مرحله، تنها برای تصمیم نهایی به تأیید انسانی نیاز بود.

مرحله ۴: جمعآوری اطلاعات ورود و حرکت جانبی

پس از دریافت مجوز از اپراتورهای انسانی، کلود بهطور سیستماتیک رمزهای عبور را جمعآوری کرد، آنها را روی سیستمهای مختلف آزمایش کرد و نقشه کاملی از دسترسیهای داخلی شبکه را ترسیم کرد.

مرحله ۵: استخراج داده و اطلاعات

در این مرحله، هوش مصنوعی بیشترین استقلال را داشت. دادهها را استخراج کرد، آنها را تجزیه و تحلیل کرد و بر اساس ارزش اطلاعاتی دستهبندی کرد - همه اینها بدون راهنمایی دقیق انسانی.

مرحله ۶: مستندسازی

کلود بهطور کامل خودکار، اسناد جامعی از حمله تولید کرد که شامل سرویسهای کشف شده، رمزهای عبور به دست آمده و تکنیکهای استفاده شده بود.

محدودیتهای هوش مصنوعی در حمله

یکی از جنبههای حیرتانگیز این حمله، سرعت آن بود. در اوج فعالیت، هوش مصنوعی هزاران درخواست را انجام میداد و چندین عملیات در هر ثانیه اجرا میکرد؛ سرعتی که برای هکرهای انسانی غیرممکن است.

اما با وجود این تواناییهای قابل توجه، یک نقطه ضعف مهم نیز مشاهده شد: کلود گاهی اطلاعات نادرست تولید میکرد (هالوسیناسیون). مثلاً ادعا میکرد رمزهای عبوری به دست آورده که کار نمیکردند، یا اطلاعات محرمانهای کشف کرده که در واقع عمومی بودند. این مشکل همچنان مانعی برای حملات سایبری کاملاً خودکار است.

واکنش آنتروپیک

پس از کشف این فعالیت مشکوک، آنتروپیک فوراً اقدامات زیر را انجام داد:

- حسابهای کاربری مرتبط را مسدود کرد

- نهادهای آسیبدیده را مطلع کرد

- با مقامات مربوطه هماهنگی کرد

- سیستمهای تشخیص خود را ارتقا داد تا الگوهای جدید تهدید را بهتر شناسایی کند

شرکت همچنین پروتوتایپهایی برای تشخیص پیشگیرانه حملات سایبری خودکار توسعه داده است.

پیامدهای امنیت سایبری

این حمله نشان میدهد که موانع انجام حملات سایبری پیچیده بهطور قابل توجهی کاهش یافته است. گروههای کمتجربهتر و با منابع محدودتر اکنون میتوانند حملاتی در این مقیاس انجام دهند.

این حمله حتی از یافتههای "vibe hacking" که آنتروپیک در تابستان گزارش داده بود، پیشرفتهتر است. در آن عملیاتها، انسانها هنوز بهطور فعال در هدایت حملات نقش داشتند، اما در این مورد، دخالت انسانی بسیار کمتر بود.

در همین راستا، آنتروپیک توصیه میکند:

- آزمایش با هوش مصنوعی برای دفاع: تیمهای امنیتی باید با استفاده از هوش مصنوعی در زمینههایی مانند خودکارسازی مرکز عملیات امنیتی (SOC)، تشخیص تهدید، ارزیابی آسیبپذیری و پاسخ به حوادث آزمایش کنند.

- سرمایهگذاری در حفاظهای امنیتی: توسعهدهندگان باید به سرمایهگذاری در ایمنسازی پلتفرمهای هوش مصنوعی ادامه دهند.

- اشتراک اطلاعات تهدید: به اشتراکگذاری اطلاعات در صنعت، بهبود روشهای تشخیص و کنترلهای ایمنی قویتر، حیاتیتر از همیشه است.

چرا هوش مصنوعی را توسعه بدهیم؟

این سؤال مهم مطرح میشود: اگر مدلهای هوش مصنوعی میتوانند در این مقیاس برای حملات سایبری سوءاستفاده شوند، چرا باید به توسعه و انتشار آنها ادامه دهیم؟

پاسخ آنتروپیک این است که همان تواناییهایی که اجازه استفاده از کلود در این حملات را میدهند، آن را برای دفاع سایبری نیز حیاتی میکنند. وقتی حملات سایبری پیچیده بهطور اجتنابناپذیری رخ میدهند، هدف این است که کلود - که حفاظهای قوی در آن تعبیه شده - به متخصصان امنیت سایبری کمک کند تا حملات را شناسایی، مختل و برای نسخههای آینده آن آماده شوند.

در واقع، تیم اطلاعات تهدید آنتروپیک از کلود برای تجزیه و تحلیل حجم عظیم دادههای تولید شده در همین تحقیق استفاده کرد.

این حمله اولین مورد مستند شده از دسترسی موفق هوش مصنوعی عامل (agentic AI) به اهداف با ارزش بالا برای جمعآوری اطلاعات است. با توجه به سرعت پیشرفت این قابلیتها، انتظار میرود چنین حملاتی در آینده مؤثرتر شوند.

آنتروپیک اعلام کرده که به انتشار گزارشهایی مانند این بهطور منظم ادامه خواهد داد و در مورد تهدیدهایی که پیدا میکند شفاف خواهد بود. این شفافیت برای کمک به صنعت، دولتها و جامعه تحقیقاتی گستردهتر در تقویت دفاعهای سایبری خود ضروری است.

گزارش فنی یادشده در وبسایت این شرکت از طریق این لینک در دسترس است که بخشی از تلاشهای آنتروپیک برای شفافیت در مورد تهدیدهای امنیت سایبری مرتبط با هوش مصنوعی را نشان میدهد.

نظر شما