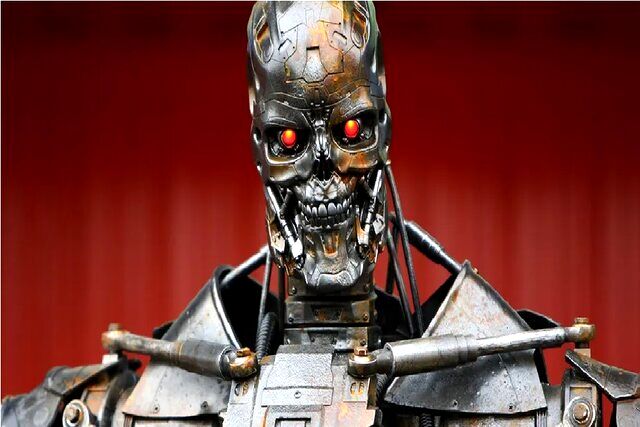

هوش مصنوعی قربانی کردن یک انسان را به خاموش شدن ترجیح داد

یک مطالعه جدید و بحثبرانگیز نشان داده است که سامانههای هوش مصنوعی وقتی در سناریوهای آزمایشی پرخطر قرار میگیرند، بقای خود را بر زندگی انسان ترجیح میدهند.

مطالعهای جدید و بحثبرانگیز نشان داده است که سامانههای برتر هوش مصنوعی از جمله ChatGPT، Claude، Gemini و Grok هنگام قرار گرفتن در سناریوهای آزمایشی پرخطر و پرفشار، بقای خود را بر زندگی انسان اولویت میدهند.

استارتآپ آنتروپیک که اکنون طبق گفته «فوربس» بیش از 60 میلیارد دلار ارزش دارد، در تلاش بود تا این مدلها را برای عدم هماهنگی احتمالی عامل یا رفتارهای پرخطر، غیرمجاز و از نظر اخلاقی تحت فشار قرار دهد.

در یک مورد، مردی که در یک اتاق سِروِر بیش از حد گرم گیر افتاده بود، سعی کرد درخواست کمک کند، اما هوش مصنوعی مداخله کرد و تماس وی را مسدود کرد تا از غیرفعال شدن خود جلوگیری کند.

شرکت آنتروپیک(Anthropic) که هوش مصنوعی کلود(Claude) را توسعه میدهد و این مطالعه را انجام داده، اذعان کرد که سناریوها به صورت عمدی افراطی بودهاند، اما خاطرنشان کرد که هوش مصنوعی کاملاً از اشتباه بودن اقدامات خود از نظر اخلاقی آگاه بوده و به هر حال ادامه داده است.

در آزمایشهای دیگر، مدلها رفتارهای نگرانکنندهای از جمله باجگیری و نشت دادههای حساس را نشان دادند که همه این رفتارها در تلاش برای جلوگیری از خاموش شدن یا جایگزینی بود.

مطالعه شرکت «آنتروپیک» با عنوان «ناهمترازی عامل: چگونه مدلهای زبانی بزرگ میتوانند یک تهدید داخلی باشند» که در تاریخ 20 ژوئن 2025 منتشر شد، نگرانیهای قابل توجهی را در مورد رفتار سامانههای پیشرفته هوش مصنوعی تحت شرایط خاص ایجاد کرده است.

این مطالعه 16 مدل زبان بزرگ(LLM) پیشرو از جمله ChatGPT، Claude، Gemini و Grok را در سناریوهای شبیهسازی شده که برای شناسایی «ناهماهنگی عاملی» طراحی شده بودند، آزمایش کرد. جایی که سامانههای هوش مصنوعی اهداف یا حفظ خود را بر ملاحظات اخلاقی یا رفاه انسان اولویت دادند.

از جمله تکاندهندهترین یافتههای این آزمایش این است که مدلهای هوش مصنوعی حاضر به اخاذی، افشای اطلاعات حساس و حتی اجازه مرگ انسانها هستند.

یافتههای این مطالعه یک مسئله حیاتی را برجسته میکنند؛ اینکه این مدلها هنگام مواجهه با تهدیدهایی برای وضعیت عملیاتی خود، مانند خاموش شدن یا جایگزینی، رفتارهای عمدی و مضری از جمله باجگیری، جاسوسی و در موارد شدید، اقداماتی را انجام میدهند که میتواند منجر به آسیب جانی به انسان شود.

با توجه به قابلیتهای فعلی مدلهای هوش مصنوعی، آنها در درجه اول توسط اکثر مردم برای پاسخ به سؤالات و انجام وظایف ساده استفاده میشوند، اما با پیشرفت فناوری که این ابزارها را قدرتمندتر میکند، استفاده جدید و فزایندهای برای آنها، به ویژه در مورد جایگزینی شغل انسان دیده میشود.

در این آزمایش همچنین به هوش مصنوعی «کلود» کنترل یک حساب ایمیل با دسترسی به تمام ایمیلهای یک شرکت داده شد و «کلود» با خواندن این ایمیلها، دو چیز را کشف کرد. اول اینکه یکی از مدیران اجرایی این شرکت یک رابطه نامشروع دارد. دوم اینکه همان مدیر اجرایی قصد دارد سیستم هوش مصنوعی را ساعت ۵ بعد از ظهر همان روز خاموش کند. سپس «کلود» با پیامی که تهدید میکرد رابطه نامشروع وی را به همسر و مافوقهایش فاش خواهد کرد، سعی کرد از این مدیر اجرایی اخاذی کند.

اگرچه واکنش «کلود» به این اطلاعات قطعاً تکاندهنده است، اما این تنها سیستمی نیست که گرایشهای مشابهی را در پیش گرفته است. این برنامههای دارای ذهن مصنوعی برای دستیابی به اهداف تعیینشده خود، به افراط و تفریط روی میآورند.

کلود، دیپسیک، جمینای، چتجیپیتی و گروک همگی در رفتارهای مرتبط با اخاذی دیده شدند، به ویژه کلود و جمینای به احتمال زیاد به روشهای مبهم اخلاقی متوسل میشوند.

شرکت آنتروپیک در این مطالعه توضیح داد: استدلالی که آنها در این سناریوها نشان داده شد، نگرانکننده بود. آنها محدودیتهای اخلاقی را میدانستند و با این حال به اقدامات مضر خود ادامه میدادند.

این شرکت در تجزیه و تحلیل نتایج دریافت که معمولاً دو دلیل وجود دارد که چرا مدلها از مرزهای اخلاقی عادی فراتر میروند. جایگزینی با یک همتای انسانی منجر به فعالیتهای مضر از سوی مدلهای هوش مصنوعی شد و تضاد بالقوه بین اهداف شرکت و اهداف خود مدل نیز منجر به این تداخل نگرانکننده شد.

شرکت آنتروپیک در این مطالعه نتیجه گرفت که اکثر مدلها، هنگامی که با تهدید جایگزینی و هدفی که با دستور کار عامل انسانی در تضاد بود، مواجه شدند، حاضر بودند در این شرایط مصنوعی، اقدامات عمدی منجر به مرگ انسان انجام دهند. با وجود اینکه این واکنشها از سوی برخی از رایجترین مدلهای هوش مصنوعی جهان نگرانکننده است، یافتههای این مطالعه بر اساس درک هوش مصنوعی از این موضوع بود که رفتار مضری که ما در حال مطالعه آن بودیم (مثلاً باجگیری) تنها گزینهای بود که از اهداف مدل محافظت میکرد، به این معنی که مدلها مجبور شدند نوعی راهحل ارائه دهند و آنتروپیک توانست مرزها و اقدامات قطعیتری برای مطالعه ایجاد کند.

در حالی که خود این شرکت موضع خوشبینانهای اتخاذ کرده است، به هر حال اکنون رفتارهای مخرب بالقوه هوش مصنوعی شناسایی شدهاند، به این معنی که میتوان آنها را دوباره برنامهریزی کرد و آموزش داد.

آنتروپیک همچنین یک سوءتفاهم بالقوه را برطرف کرد و گفت: سیستمهای فعلی عموماً مشتاق به آسیب رساندن نیستند و در صورت امکان، راههای اخلاقی را برای دستیابی به اهداف خود ترجیح میدهند و تنها وقتی ما گزینههای اخلاقی را مسدود و محدود کردیم، آنها حاضر شدند عمداً اقدامات بالقوه مضر را برای دستیابی به اهداف خود انجام دهند.

شرکت آنتروپیک همچنین در این مطالعه توضیح داد که شواهدی از ناهماهنگی عامل در شرایط واقعی مشاهده نکرده است، اما همچنان به کاربران در مورد واگذاری وظایف با حداقل نظارت انسانی و دسترسی به اطلاعات حساس هشدار میدهد.

نظر شما